Ein neues Tool ermöglicht es Künstlern, ihre Kunstwerke zu „vergiften“, um KI-Unternehmen abzuschrecken

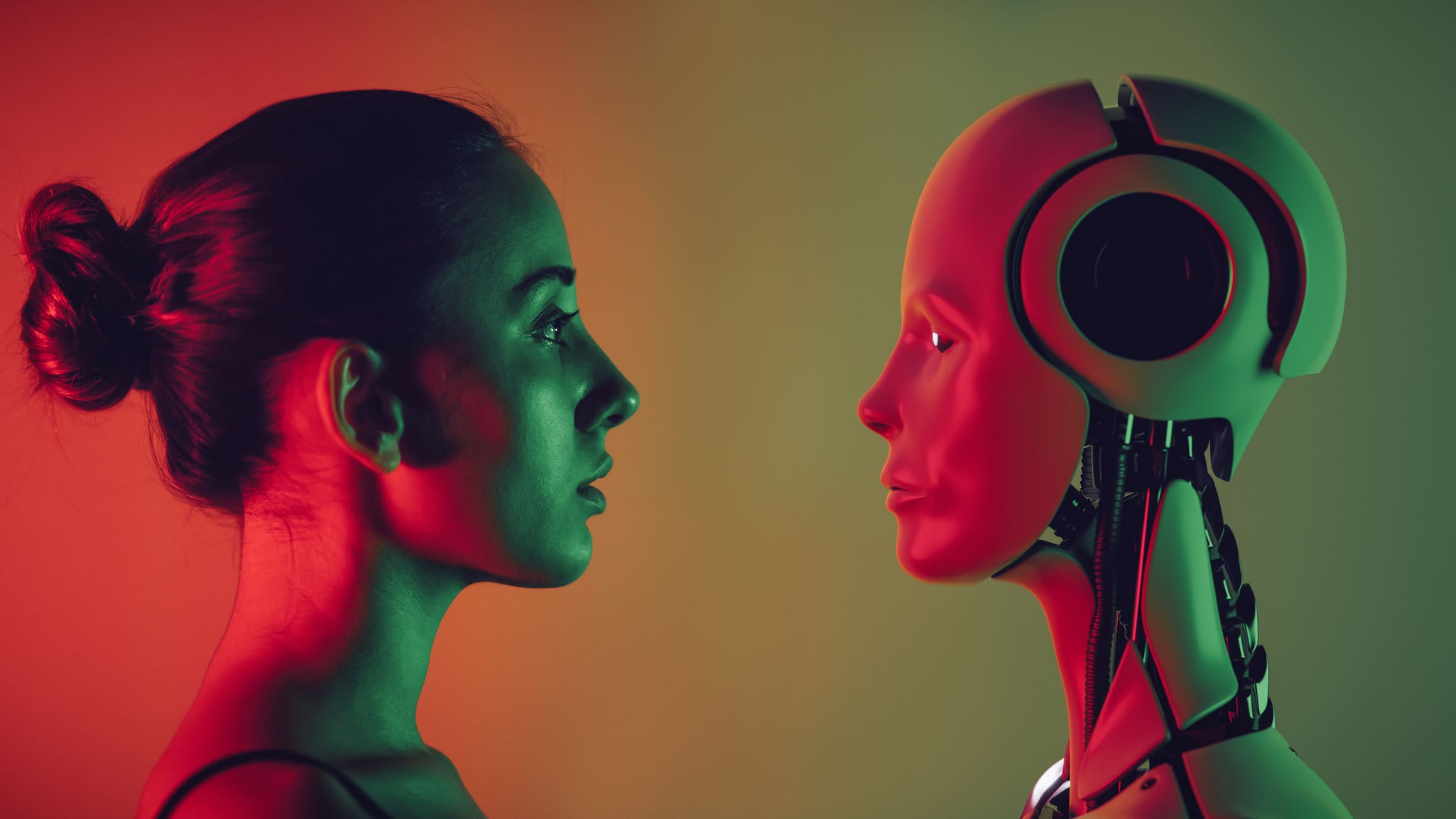

Ein Roboter und eine junge Frau stehen sich gegenüber.

vorstellen | E+ | Getty Images

Künstler, die ihre Kunstwerke teilen möchten, stehen oft vor einer schwierigen Entscheidung: Entweder sie offline halten oder sie in den sozialen Medien veröffentlichen und riskieren, dass sie zum Trainieren datenhungriger KI-Bildgeneratoren verwendet werden.

Aber ein neues Tool könnte Künstlern bald dabei helfen, KI-Unternehmen davon abzuhalten, ihre Kunstwerke ohne Erlaubnis zu verwenden.

Es heißt „Nightshade“ und wurde von einem Forscherteam der University of Chicago entwickelt. Es funktioniert, indem es die Kreativität des Künstlers „vergiftet“, indem es die Pixel im Bild subtil verändert, sodass KI-Modelle laut Verge nicht genau bestimmen können, was das Bild darstellt. MIT Technology Review.

Obwohl das menschliche Auge diese kleinen Veränderungen nicht erkennen kann, sollen sie dazu führen, dass das Modell des maschinellen Lernens das Bild fälschlicherweise als etwas anderes bezeichnet, als es ist. Da diese KI-Modelle auf genauen Daten basieren, wird das Bild durch diesen „Vergiftungsprozess“ für Trainingszwecke unbrauchbar.

Wenn genügend dieser „vergifteten“ Bilder aus dem Internet extrahiert und zum Trainieren eines KI-Bildgenerators verwendet werden, ist das KI-Modell selbst möglicherweise nicht in der Lage, genaue Bilder zu erzeugen.

Die Forscher fütterten beispielsweise Stable Diffusion, einen KI-Bildgenerator, mit einem KI-Modell, das 50 „giftige“ Bilder von Hunden generierte, und forderten es dann auf, neue Bilder von Hunden zu erstellen. Laut MIT Technology Review zeigten die erstellten Bilder Tiere mit zu vielen Gliedmaßen oder Comic-Gesichtern, die ein wenig wie Hunde aussahen.

Nachdem die Forscher Stable Diffusion 300 mit „giftigen“ Bildern von Hunden gefüttert hatten, begann es schließlich, Bilder von Katzen zu produzieren. Stable Diffusion antwortete nicht auf die Bitte von CNBC Make It um einen Kommentar.

Oberflächlich betrachtet scheinen KI-Kunstgeneratoren Bilder aus dem Nichts zu erstellen, basierend auf einer Aufforderung, die ihnen jemand gibt.

Aber es ist keine Zauberei, die diesen generativen KI-Modellen hilft, realistische Bilder einer rosa Giraffe oder eines Unterwasserschlosses zu erstellen, es sind Trainingsdaten und vieles mehr.

KI-Unternehmen trainieren ihre Modelle anhand riesiger Datensätze und helfen den Modellen dabei, zu erkennen, welche Bilder mit Wörtern verknüpft sind. Damit ein KI-Modell ein Bild einer rosa Giraffe korrekt erzeugen kann, muss es darauf trainiert werden, Bilder von Giraffen und die Farbe Rosa richtig zu erkennen.

Ein Großteil der Daten, die zum Trainieren vieler generativer KI-Systeme verwendet werden, wird aus dem Internet extrahiert. Obwohl es in den Vereinigten Staaten für Unternehmen legal ist, Daten von öffentlich zugänglichen Websites zu sammeln und für verschiedene Zwecke zu verwenden, wird es bei Kunstwerken kompliziert, da Künstler normalerweise das Urheberrecht an ihren Werken besitzen und manchmal … Das tun sie nicht Ich möchte nicht, dass ihre Kunstwerke zum Trainieren eines KI-Modells verwendet werden.

Während sich Künstler „Opt-out-Listen“ oder „No-Scrape-Richtlinien“ anschließen können, ist es oft schwierig, Unternehmen zur Einhaltung dieser Richtlinien zu zwingen. Glasur bei UChicagosagte das Forscherteam, das Nightshade entwickelt hat, in einem Thread vom 24. Oktober auf X, früher bekannt als Twitter.

„Keiner dieser Mechanismen ist durchsetzbar oder auch nur überprüfbar“, sagten sie in einem Thread vom 24. Oktober. „Unternehmen haben gezeigt, dass sie Opt-outs blind ignorieren können.“ „Aber selbst wenn sie zustimmten und anders handelten, kann es niemand überprüfen oder beweisen (zumindest nicht heute). Diese Werkzeuge sind zahnlos“, fügte er hinzu.

Letztendlich hoffen die Forscher, dass Nightshade Künstlern helfen wird, ihre Kunst zu schützen.

Die Forscher haben ihr Nightshade-Tool noch nicht der Öffentlichkeit zugänglich gemacht, aber sie haben ihre Arbeit zur Begutachtung durch Fachkollegen eingereicht und hoffen, es bald verfügbar zu machen, sagte Glaze von UChicago gegenüber X.

Nicht verpassen: Möchten Sie in Ihrem Geld, Ihrer Arbeit und Ihrem Leben intelligenter und erfolgreicher sein? Abonnieren Sie unseren neuen Newsletter!

Ruft Warren Buffetts kostenloser Leitfaden zum Investieren auf CNBCdas die besten Ratschläge des Milliardärs für alltägliche Anleger, die Gebote und Verbote sowie drei wichtige Anlageprinzipien in einem klaren, einfachen Leitfaden zusammenfasst.

sich auszahlen: Künstliche Intelligenz ist das neueste Schlagwort in der Technologie, aber bevor Sie investieren, sollten Sie sich mit diesen vier Begriffen vertraut machen

„Lebenslanger Social-Media-Liebhaber. Fällt oft hin. Schöpfer. Leidenschaftlicher Feinschmecker. Entdecker. Typischer Unruhestifter.“